L’IA conversationnelle et les Chatbots IA comme ChatGPT ont-ils la capacité à impacter nos fonctions exécutives, notamment au travers du délestage cognitif, au risque de nous rendre imbéciles?

Nous avons tous été impressionnés par la capacité de réponse fournie par les derniers Chatbot IA comme ChatGPT. Bien que nous soyons sensibilisés aux dangers potentiels liés au développement d’une super-intelligence artificielle (ou IAG, Intelligence Artificielle Générale), peu d’études ont été menées sur l’impact de ces outils sur nos capacités cognitives. Des recherches récentes (Léon-Dominguez, 2024) tentent d’évaluer l’impact de ces outils d’IA génératives sur nos fonctions cognitives de haut niveau comme le raisonnement, la résolution de problèmes ou notre capacité de planification. Nous étudierons trois scénarios possibles en lien avec l’évolution de cette technologie et son impact possible sur nos fonctions exécutives.

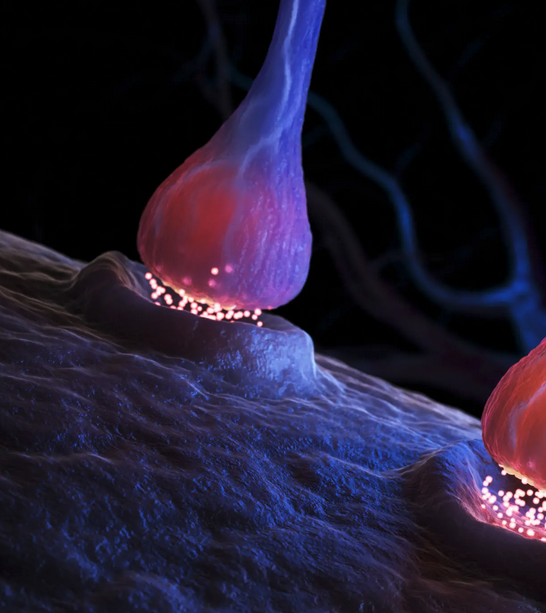

Le développement de réseaux de neurones dit Transformers (Vaswani et al., 2017) a permis l’émergence de nouveaux Grand Modèles Linguistiques (Large Langage Models) aux capacités hors norme. En entrainant les modèles d’IA sur des masses considérables de données, les derniers concepteurs de Chatbots ont développé des outils ayant une compréhension plus riche de notre langage et des capacités conversationnelles encore jamais vues. Cette compréhension de notre langage étant affinée continuellement à nos préférences via un mécanisme d’apprentissage renforcé par évaluation humaine (RLHF ou Reinforcement Learning from Humain Feedback).

Le lancement de ChatGPT en version gratuite a donc assuré un déploiement rapide de cette technologie et une pertinence accrue dans de nombreux domaines: techniques (codes), communication personnelle (rédaction d’emails, traduction), services personnels (planification des vacances, recettes culinaires), éducation (aide à la rédaction), créativité (brainstorming et story telling). Bien que des discussions d’ordre éthique ont couramment lieu (i.e. biais algorithmiques, droits d’auteurs, etc.), trop peu de recherches visent à étudier sur le long terme l’impact de ces outils sur nos capacités cognitives de haut-niveau.

Si je devais résumer le paragraphe ci-dessus le plus simplement du monde : Les concepteurs d’IA génératives comme OpenAI ont aspiré l’ensemble des savoirs humains (Wikipédia, les grands ouvrages littéraires numérisés, les recherches scientifiques, les photos et images disponibles sur Internet, les contenus de blogs, sites d’actualité…), enfin à peu près tout ce que l’humanité a produite et publiée… avec peu de considération pour les données personnelles et la notion de droits d’auteurs (le motto Move Fast and Break Things de Facebook semble remis au goût du jour) pour proposer des assistants personnels aux capacités hors norme. Ces outils sont tellement puissants que nous pourrions être amenés à leur déléguer de plus en plus de nos tâches complexes. Mais en devenant encore plus fainéants intellectuellement, ne risquerions-nous pas de nous abrutir ? C’est ce que nous allons tenter de découvrir … :).

Plusieurs facteurs ont fortement contribué à l’expansion de notre cerveau d’Homo Sapiens, notamment les facteurs environnementaux, sociaux et culturels. Les interactions constantes avec ces objets génèrent de nouvelles compétences qui s’intègrent alors à nos capacités cognitives pour être ensuite transmises par « effet cliquet » aux générations suivantes (Tennie et al. 2009), et ainsi nous transformer en Homo Sapiens Technologicus.

La Théorie de l’Engagement Matériel (Malafouris, 2019) examine comment nos interactions matérielles influencent la façon dont nous percevons, agissons et pensons. Cette approche soutient que notre relation avec les objets et les artefacts n’est pas simplement utilitaire, mais qu’elle façonne activement notre manière de comprendre le monde. Voyons dans la section suivante comment notre cerveau réussi à acquérir de nouvelles compétences.

En 2011, des expérimentations ont été réalisées pour analyser les conséquences sur nos fonctions cognitives d’avoir un accès quasi instantané à toutes les informations, notamment via le moteur de recherche Google (Sparrow, Liu, Wegner, 2011). Les résultats sont éloquents. Confrontés à des questions difficiles, nous privilégions avant tout l’ordinateur pour trouver les solutions et notre capacité de mémorisation diminue encore plus si nous savons pouvoir retrouver l’information plus tard. Internet est devenu notre mémoire externe ou l’information est stockée collectivement en dehors de nous-mêmes et à laquelle nous pouvons accéder à tout moment.

De manière assez logique, nous avons tendance à mettre plus de temps à retrouver une information dans notre cerveau que nous ne pensions plus utile à conserver. Si nous pensons qu’une information sera disponible continuellement, nous nous rappelons plus du lieu ou trouver l’information que des détails de l’information elle-même.

Ces éléments suggèrent que les processus de la mémoire humaine s’adaptent aux nouvelles technologies, avec une contrainte majeure, la nécessité pour nous de rester connecté aux machines et le risque de créer des dépendances (Notre connexion Internet et Google dans le cas présent).

Les individus confrontés durant leur vie à des tâches nécessitant une haute disponibilité cognitive (i.e. tâches intensives ou high cognitive demand tasks) tendent à posséder des capacités intellectuelles supérieures (Potter et al., 2022).

L’acquisition de nouvelles compétences techniques lors de la manipulation d’objets peut introduire des changements structuraux et connectiques au sein de niches neuronales dans notre cerveau (Dehaene & Cohen, 2007). Ainsi, notre cerveau peut transformer sa propre structure et créer de nouvelles niches cognitives pour contrôler la manipulation de ses outils, qu’ils soient physiques ou symboliques (dessin, mots, nombres…). Les Chatbots, au travers des nouvelles techniques qu’ils introduisent (i.e. les fameux prompts ou requêtes) et l’interaction de leurs réponses avec nos processus cognitifs, pourraient avoir une influence significative sur le développement de la cognition humaine.

Les Chatbots IA pourraient améliorer nos fonctions cognitives (cognitive augmenter ou cognitive enhancers) dans la mesure ou ils augmenteraient certaines de nos performances au-delà de nos limites biologiques, comme celles touchant les fonctions de haut-niveau. Ces fonctions, regroupées sous le terme de fonctions exécutives, constituent un « ensemble de processus permettant à un individu de réguler de façon intentionnelle sa pensée et ses actions afin d’atteindre des buts, ceci lorsque la tâche est nouvelle ou complexe (Chevalier, 2010).

Les Chatbots IA pourraient nous affranchir de nos limites physiologiques en nous permettant un délestage cognitif (Cognitive offloading), nous permettant de nous concentrer sur d’autres tâches et potentiellement de réduire l’effort cognitif qu’il nous aurait fallu déployer pour répondre à notre tâche.

Bien que les bénéfices à court terme soient facilement mesurables, en terme de gain de productivité dans l’exécution d’une tâche donnée, nous manquons actuellement d’études sur les impacts potentiels d’un usage à long terme de ces technologies, et la conséquence de ce délestage cognitif. En augmentant note dépendance à la technologie et en déléguant aux Chatbots IA certaines tâches faisant traditionnellement appellent à nos fonctions exécutives, nous pourrions prendre le risque de voir notre cerveau remodeler nos connections neuronales (Werhahn et al., 2002) au risque d’affecter nos capacités de réflexion, d’analyse, de décision,…et ainsi réduire notre capacité d’adaptation et de réaction à des circonstances nouvelles ou imprévues (Kayes & Yoon, 2022).

Mais alors que l’utilisation continue d’outils technologiques comme les Chatbots IA se développe au sein de nos sociétés, comment ces technologies pourraient s’intégrer dans notre quotidien et quelles pourraient-être les conséquences sur nos fonctions cognitives ? A la différence d’autres innovations technologiques qui avaient comme finalité première de nous assister dans des tâches plus complexes, ChatGPT pour ne citer que lui est probablement le premier outil technologique culturel massivement déployé à pouvoir générer des solutions verbales sous forme de plan d’action complet. Alors que des technologies comme les smartphones ou Google peuvent nous assister d’un point de vue cognitif, il est cependant nécessaire que l’utilisateur conserve une attention, un effort de mémoire et réalise un travail d’analyse afin d’intégrer les informations dans son propre plan d’action.

Imaginons maintenant trois scénarios, du plus conservateur au plus dystopique, sur les effets à long terme que pourraient avoir les IA génératives sur le développement de notre cerveau.

Cette première hypothèse considère que l’usage généralisé de Chatbots IA comme ChatGPT n’aura pas d’impact plus significatif cognitivement parlant que lors de l’avènement de la calculatrice, l’ordinateur ou les smartphones (Cecutti et al., 2012). Les effets de ces technologies sur nos capacités cognitives sont aujourd’hui encore difficiles à mesurer car de nombreux facteurs rentrent en jeu. On note cependant quelques tentatives pour mesurer l’impact de ces technologies sur notre développement cérébrale et notre performance. L’effet Flynn (Reese, 1996) par exemple relie positivement un usage de la technologie à une augmentation de notre QI au fil du temps. Cependant, de très nombreuses études par la suite ont démontré l’inexactitude de cette causalité en démontrant paradoxalement un effet inverse sur notre QI.

Dans ce scénario optimiste, l’usage généralisé de Chatbots AI pourrait en premier lieu bénéficier aux individus les moins qualifiés car n’ayant pas traditionnellement accès à ce genre d’outils et à ces connaissances (Dell’Acqua et al, 2023).

Prétendre que l’interaction avec des Chatbots IA pourrait avoir des répercutions sur nos capacités cognitives semble exagérée au regard du phénomène que l’on appelle near and far transfer in cognitive training. Cette méta-étude indique un transfert limité de nouvelles fonctions cognitives acquises lors de formations spécifiques sur certaines fonctions cognitives (e.g. raisonnement, rapidité et langage). Ainsi, l’usage de Chatbots AI pourrait avoir un impact négatif tout à fait limité sur nos fonctions cognitives, qui pourrait être contrebalancé par les très nombreuses stimulations liées à notre environnement et les défis cognitifs apparaissant dans nos vies quotidiennes. Nous serions dans ce scénario sur un jeu à somme nulle, ou les bénéfices et les effets négatifs se neutraliseraient au sein de la population.

Ce troisième scénario, volontairement dystopique, considère un usage de Chatbots IA non plus comme une ressource externe, mais comme une prothèse cognitive qui a la capacité de remplacer intégralement une fonction cognitive de haut-niveau comme notre capacité à penser. Ici, nul besoin pour l’utilisateur de soumettre des instructions verbales ou écrites (i.e. des prompts), les informations étant directement induites par l’environnement permettant de proposer des recommandations ou des actions à l’utilisateur.

Pour ce faire, cette Intelligence Artificielle devra faire partie d’un système intégré de capteurs biométriques implantés dans le corps et le cerveau de l’individu et permettant de collecter des données internes (biologiques) et externes (environnementales) Ces capteurs pouvant être apposés sur la rétine (pour une vision augmentée), le pavillon de l’oreille (pour l’écoute), le cortex somatosensoriel (pour les perceptions haptiques), le lobe pariétal (pour la proprioception et le goût), ou le cœur (pour les activités des systèmes nerveux sympathiques et parasympathiques) pour évaluer l’environnement interne de l’utilisateur.

L’ensemble des informations collectées pourra ensuite être envoyée à une base de données centralisée afin d’être stocké, analysé et pourra ensuite prédire des comportements futurs. L’algorithme « Actor-Critic Reinforcement Learning Algorithm » (ou ACRL) utilise un mécanisme d’apprentissage renforcé en analysant des stimuli dans l’environnement pour proposer des actions potentielles en fonction de probabilités. (Trivedi & Hemachandra, 2022).

Les réponses pourraient ainsi être transmises à l’utilisateur, non plus au moyen de l’écran d’un smartphone, mais au travers de lentilles connectées ou de stimulations dans le cortex occipital.

A l’heure actuelle et alors que la technologie existe, son déploiement est peu probable à court terme du fait de la complexité de produire le matériel adéquat (i.e. œil bionique, Knudsen et al., 2023) et les enjeux en terme de captation en temps réel de la donnée. (Y. Gao et al., 2023).

Mais poussons le concept jusqu’au bout à travers une expérience de pensée. Dans ce scénario, chaque individu a accès à un système intégré composé de capteurs biométriques, d’un Chatbot IA et d’un algorithme ACRL (qui propose des actions susceptibles d’arriver en fonction du contexte) et d’une connexion Internet. Nous nommerons ce système le Système de Support pour l’Aide à la Décision Cognitive, ou SYSU-ADC. Alice, notre cobaye du jour, est volontaire pour qu’on lui implémente le SYSU-ADC dans son corps. À mesure que le système se familiarise avec Alice et son environnement, il est rapidement capable de limiter ses propositions à une seule action, la plus probable à celle qu’Alice aurait choisi. Et Alice se trouve confiante et apaisée dans cet unique choix, car après tout, le système mesure également les réactions biologiques et les émotions d’Alice. Dans ce scénario dystopique, Alice devient semi-passive et subit les instructions visuelles et verbales de SYSU-ADC. S’en suit irrémédiablement la baisse puis la disparition de la petite voix intérieure d’Alice (Inner speech, ou covert speech, Flavell et al., 1966), vous savez, cette petite voix qui nous parle, ce dialogue souvent inconscient, parfois volontaire, avec nous-même? Hors, cette voix intérieure a une fonction d’auto-régulation des comportements et semble même intervenir activement lorsque nous tentons de résoudre des problèmes complexes. Chez les enfants, il a été démontré que l’usage de cette voix intérieure (appelée langage égocentrique chez l’enfant) était lié à une amélioration des performances cognitives (Klein, 1964).

Pour revenir à Alice, nous assistons dans notre scénario à une substitution de sa voix intérieure par le langage externe proposé par le Chatbot IA, ce qui pourrait avoir des conséquences cognitives majeures : impact sur la régulation des émotions et des comportements, du raisonnement, de la catégorisation, du contrôle de l’inhibition… En ne dépendant plus que des instructions externes, Alice, alors en mode auto-pilote, perdrait sa volonté, sa capacité d’introspection et sa propre conscience, et n’aurait alors plus qu’une option, suivre les instructions de la machine, sans possibilité de remise en cause.

D’immenses progrès ont été fait, depuis les premières expérimentations avec des Chatbots comme ELIZA (Weizenbaum, 1966), jusqu’aux Chatbots IA actuels capables de raisonnements analytiques et de résolutions de problèmes, à même de surpasser les capacités humaines dans bien des domaines, y compris militaires (voir HPET, Human Performance Enhancement Technology, Shao et al. , 2021), voir même de nous faire toucher du doigt l’immortalité. Mais alors, quels impacts potentiels sur notre développement cognitif?

Les scénarios spéculatifs développés précédemment qui projettent une intégration de Chatbots IA dans nos activités quotidiennes mettent en lumière les impactent possibles de l’Intelligence Artificielle sur nos processus cognitifs humains.

Alors que le bénéfice sur la performance individuelle peut être facilement mis en exergue, l’impact des changements cognitifs sur la société n’est pas encore établi, compte tenu des cas d’usages possibles, de l’importance du délestage cognitif et des futures innovations dans les produits actuellement mis sur le marché. Alors que nous manquons de recul sur les impacts potentiels, il devient plus qu’urgent de réglementer l’usage et contrebalancer les effets potentiellement négatifs, en mesurant les impacts sur nos fonctions cognitives, en développant des programmes éducatifs, et en explorant des régulations ciblant les technologies émergentes, notamment celles liées à l’utilisation de capteurs biométriques associée à des modèles d’Intelligence Artificielle. Ne reproduisons-pas avec l’IA les erreurs commises avec les réseaux sociaux. L’histoire récente nous a malheureusement montré que l’utilisation de la science et la technologie à des fins purement économiques, et sans aucun contrôle, pouvait avoir des conséquences dramatiques, notamment en affectant notre trésor attentionnel (Bronner, 2021) dans un monde ou les formes de propagations (d’idées, de fake news…) sont plus rapides et plus protéiformes, sans possibilité d’exercer son droit à l’oublie.

Pour des raisons de cohérence, ce post comme tous les autres sur ce blog, est garanti 100% « human generated », sauf mention contraire. Cela excusera aussi possiblement les quelques fautes d’orthographes éventuelles).🙏🏻.

Pour approndir le sujet, je vous recommande l’excellent papier (ressource payante) « Potential Cognitive Risks of Generative Transformer-Based AI Chatbots on Higher Order Executive Functions » de Umberto Leon-Dominguez

2 réponses à “ChatGPT risque-t-il de faire de nous des imbéciles?”

Très intéressant.

Merci pour cette analyse.

Très instructif et intéressant. Je ferais en sorte de faire de cet article une de mes référence bibliographique dans mes recherches en neuro-ergonomie juridique. Merci beaucoup.